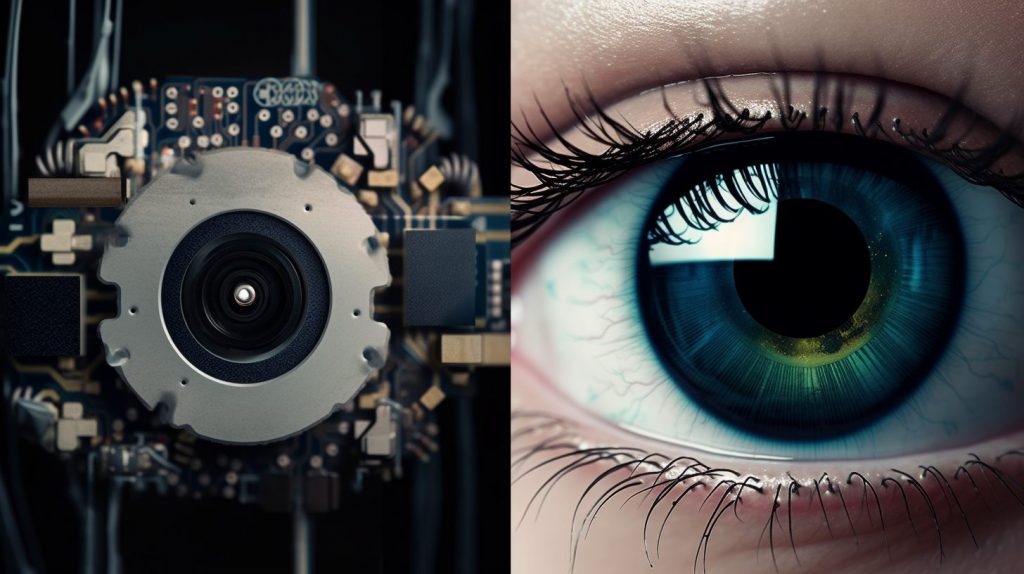

Wie Künstliche Intelligenz die Welt aus unseren Augen wahrnimmt

Über Prof. Dr. Hilde Kuehne

Prof. Dr. Hilde Kuehne forscht an der Goethe Universität Frankfurt am Fachbereich Informatik und am MIT-IBM Watson AI Lab. Sie studierte Computational Visualistics an der Universität Koblenz-Landau und promovierte am Karlsruher Institut für Technologie.

Augen und Verstand für die KI

Roboter, die kollaborativ mit Menschen arbeiten und dabei stets die passenden Werkzeuge zur Hand haben – wozu ein Mensch fähig ist, kann in der Theorie auch eine Maschine. Dafür muss sie menschliche Handlungen verstehen und Bewegungen analysieren können.

Kuehne bringt der KI das Sehen bei. Angefangen hat die „Action Recognition“ mit dem automatischen Klassifizieren und Erkennen einfacher Video-Sequenzen wie Klatschen oder Springen. Heute trainiert Kuehne KI-Systeme große neuronale Netze, die eine Fülle von menschlichen Bewegungen und Aktivitäten automatisiert erkennen und zuordnen können. Für ihre Video-Datenbank zu Human Motion Recognition wurde sie 2021 mit dem TPAMI Test-of-Time Award ausgezeichnet.

Die Herausforderung: Video-Daten sind komplex. Dieselben Aktionen haben verschiedene Bewegungsabläufe und sollen von einer KI dennoch verlässlich erkannt werden. Für Kuehne liegt die Lösung im multimodalen Lernen, das neben Video auch Text und Audio im Training der Daten umfasst. Diese zusätzlichen Daten helfen der KI dabei, eigenständiger zu werden – ein Prozess, der dem menschlichen Lernen ähnelt. Je menschennaher das Verständnis der Daten wird, desto realistischer ist deren Aussagekraft. Das wiederum verbessert das Ergebnis der Bewegungserkennung in der realen Welt.

Die multimodalen Daten setzt Kuehne in einem Koordinatensystem in Bezug zueinander. Bewegungen in Videos, die gesprochene Sprache und Texte werden sequenziert, codiert und landen in einem „multimodalen embedding space“. In diesem Raum werden die Daten nach ihrer semantischen Nähe sortiert. In diesem Raum werden die Daten nach ihrer semantischen Nähe sortiert. So entsteht mit zunehmenden Daten ein Universum an Informationen, das Bewegungen und Aktivitäten in der realen Welt besser, schneller und zunehmend eigenständiger ohne manuelle Zuarbeit erkennt.

Damit die KI die Welt ähnlich wie ein Mensch wahrnehmen kann, benötigt sie große Datenmengen, deren Aufnahme und Klassifizierung jedoch zeitaufwendig und kostspielig ist. Aktuelle Modelle werden etwa mit einer Million Videos trainiert – für Kuehne zu wenig. In der Skalierung sieht sie ein Problem: „Daten im Internet bilden nur einen Teil der realen Welt ab, nicht die ganze Welt.“ Videos auf Youtube oder Instagram ähneln sich oft in ihrer Bildsprache und das neuronale Netz kann sein Potenzial nicht ausschöpfen.

Einen Lösungsweg sieht Kuehne in synthetischen Daten, mit denen sich die Datenmenge für das KI-Training fast uneingeschränkt nach oben schrauben und variieren lässt. Denn Videos aus dem Internet haben eine ungleiche Geschlechterverteilung oder bilden Bewegungen und Aktivitäten, die in der realen Welt vorkommen, nicht ausreichend ab.

Interdisziplinäre Forschung bringt KI weiter

Um das volle Potenzial der KI auszuschöpfen, arbeitet Kuehne mit Wissenschaftler*innen aus anderen Disziplinen zusammen, etwa den Sprachwissenschaften. Sie ist überzeugt: „Forschung wird grundsätzlich kollaborativer. Die Zeiten, wo jeder Forscher sein Silo hatte, und ausschließlich in diesem Silo geforscht hat, die sind vorbei.“ Deshalb schätzt sie das Netzwerk von hessian.AI. Deshalb schätzt sie das Netzwerk von hessian.AI.

Kuehne integriert etwa Ideen aus den Vision-, Sprach-, Text- und Machine-Learning-Communities in ihre Forschung: „Der eigentliche Wert liegt im Austausch der verschiedenen Disziplinen.“ Für die Action Recognition und das multimodale Lernen ist die Verbindung verschiedener Modalitäten unabdinglich: Nur so gelingt es, die verschiedenen Sichtweisen auf die Welt in die KI-Entwicklung zu integrieren.

Die Forscherin kombiniert deshalb Sprache und Visuelles mit unterschiedlichen Informationsebenen, damit KI-Systeme besser funktionieren und für die Anwender*innen nützlich sind: etwa Assistenzsysteme, die Stürze erkennen und Menschen im Alltag unterstützen, oder Überwachungssysteme an U-Bahn-Stationen, die Personen auf den Gleisen erkennen und den Zugverkehr rechtzeitig stoppen. KI soll das Auge sein, das dem Menschen an manchen Stellen fehlt.